Kann eine künstliche Intelligenz Uhren designen?

In den vergangenen Jahren konnten neuartige neuronale Netze namens „Generative adversarial networks“ – kurz GANs – in Bereiche vordringen, die zuvor ausschließlich dem Menschen vorbehalten waren. Kreativität oder Kunst wird gemeinhin nicht als Domäne von Computern wahrgenommen. Seit dem GANs jedoch im Jahr 2014 in der Wissenschaft wiederbelebt wurden, finden generative Modelle zunehmend den Weg in diesen Bereich.

In der breiteren Öffentlichkeit bekannt wurden GANs Ende 2018, als ein KI-generiertes Bild auf Christies für 432.500 Dollar verkauft wurde. Auch Anfang 2019, wurden auf der Webseite This Person Does Not Exist von einem GAN generierte Bilder veröffentlicht. Dieses GAN generiert künstlich erschreckend realistische Bilder von Gesichtern. Aber auch in vielen anderen Bereichen werden GANs schon eingesetzt, beispielsweise zur Verbesserung von Bildern und Filmen, oder gar zur Generierung von künstlichen Szenen.

Was steckt dahinter?

Ein GAN ist ein generatives Modell. Das Besondere an generativen Modellen verbirgt sich bereits im Namen, denn ein generatives Modell kann im Gegensatz zu diskriminativen Modellen Daten selbst erzeugen, wohingegen diskriminative Modelle Daten lediglich bewerten können.

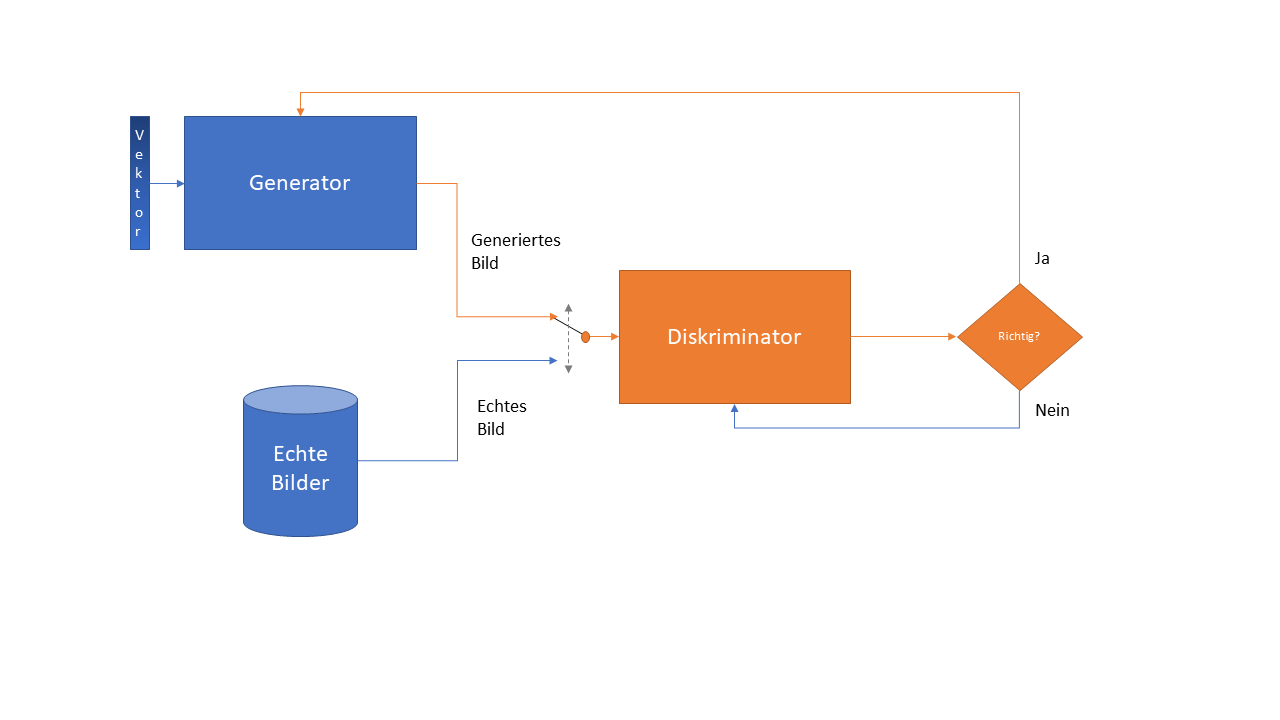

Beispiel: Ein diskriminatives Modell, welches Katzen und Hundebilder voneinander unterscheiden soll, lernt die bedingte Wahrscheinlichkeit P (A | B), bzw. ob ein gegebenes Bild zu Klasse Hund oder Katze gehört. Ein generatives Model lernt hingegen für diese Aufgabe, Bilder von Katzen und Hunden selbst zu generieren P(A, B) und arbeitet mit Vergleichen, um eine Klassifikation vorzunehmen. GANs bestehen aus zwei Hauptkomponenten: Dem Generator und dem Diskriminator. Dadurch ist sowohl ein generativer als auch diskriminativer Anteil beim Lernen des Modells involviert.

Schema zur Veranschaulichung eines generative adversarial networks (GANs)

Der Generator ist für die Erzeugung eines Bildes verantwortlich, der Diskriminator ist dagegen dafür zuständig, das Bild als „fake“ oder als „echt“ zu klassifizieren. Durch eine schlaue Kombination dieser beiden Komponenten und dem Zuführen eines Bilderdatensatzes, kann ein GAN in die Lage versetzt werden, diese Bilder aus dem Datensatz zu rekonstruieren. Das funktioniert folgendermaßen:

Der Generator erzeugt anfangs aus Rauschen ein Bild, das zunächst mit dem zugrunde liegenden Datensatz nichts gemein hat (Zufallsverteilung). Der Diskriminator versucht zu erkennen, ob es sich bei dem erzeugten Bild um ein reales Bild, oder um ein generiertes „fake“ Bild handelt. Das geschieht, indem dem Diskriminator abwechselnd entweder ein „fake“ Bild aus dem Generator oder ein „echtes“ Bild aus dem Datensatz gezeigt wird. Liegt der Diskriminator falsch, werden dessen Parameter angepasst. Er lernt also durch jede Fehleinschätzung, die Unterscheidung zu verbessern.

Auch der Generator lernt mit jedem erzeugten Bild, das von seinem Gegenspieler als „fake“ entlarvt wurde dazu und generiert beim nächsten Versuch ein besseres Bild. So wird das anfänglich erzeugte verrauschte Bild Stück für Stück den echten Bildern ähnlicher.

Mit diesem einfachen Spiel (auch als Min-Max-Game bezeichnet) verbessern sich sowohl Diskriminator als auch Generator, bis der Diskriminator nicht mehr zwischen „echt“ und „fake“ unterscheiden kann. In seiner grundlegendsten Form lassen sich dann mit einem trainierten GAN sowohl künstlerisch anmutende als auch realistische Bilder von Uhren generieren.

Vom neuronalen Netz erstellte Bilder, realistisch (oben) und künstlerisch (unten)

Steuerung des GANs (StyleGANs)

Mit den oben skizzierten GANs können bereits relativ beeindruckende Bilder generiert werden. Interessanter wird es allerdings, sobald StyleGANs einsetzt werden. Bei diesen gibt es die Möglichkeit, die Generierung von Bildern mit Parametern zu steuern, ähnlich eines Charaktererstellungseditors aus Computerspielen. Hierzu werden bestimmte Parameter innerhalb des neuronalen Netzes eingefügt, die bei einer Änderung auch zur Veränderung des erzeugten Bildes führen. So können Pose, Farbe, Lichtstimmung und weitere Details verändert werden, ohne dass manueller Aufwand erforderlich ist. Eine zweite, verbesserte Version dieses Verfahrens wurde kürzlich veröffentlicht.

Dieses Beispiel zeigt wie die Farbe der Uhr aus der oberen Reihe auf die Uhr links im Eck übertragen wird.

Hier wird die Form und der Stil der Uhr übertragen.

Und zuletzt kann der Blickwinkel oder gar die grundsätzliche Form der Uhr übertragen werden.

Limitierungen

Derzeit gibt es noch einige Limitierungen bei GANs, sodass der Einsatz eingeschränkt ist. Beispielsweise ist es schwierig, die Transformationen, die ein GAN vornimmt, auf beliebige Bilder anzuwenden. D.h. es ist out-of-the-box nicht möglich, die Stilveränderung auf Bilder anzuwenden, die nicht durch das Netz generiert wurden. Zu diesem Punkt wird jedoch viel geforscht: Zalando hat beispielsweise ein Paper veröffentlicht, in dem beschrieben wird wie mithilfe eines GANs einem Fashion-Model unterschiedliche Kleidung virtuell angezogen wird. Als weiteres Beispiel ist eine neue Architektur aus Südkorea in der Lage, aus jeglichem Selfie ein Anime-Pendant zu generieren.

Zukunft von GANs

Durch die kreative Komponente solcher generativer KI-Modelle sind vielerlei Anwendungsszenarien denkbar. Beispielsweise können die erzeugten Uhrenbilder beim Design von Luxusuhren helfen, indem verschiedene Farbkombinationen, Formen und Strukturen schnell und unkompliziert anschaulich gemacht werden. Denkbar ist auch eine Bildsynthese, die es ermöglicht, beliebig zusammengestellte Uhren auf dem Smartphone „anzuprobieren“. Im Vergleich zu anderen neuronalen Netzen, die bei Chrono24 bereits im Produktivbetrieb sind, stecken GANs allerdings noch in den Kinderschuhen. Anwendungsszenarien müssen sich erst noch stärker herauskristallisieren.

Kann eine KI also nun Uhren designen? Nein, sicherlich ist das noch nicht möglich, aber KI kann als Werkzeug dienen, um den Prozess zu vereinfachen oder Inspiration liefern.

Als weiterführende Literatur findet sich hier eine technische Sicht auf das Thema GANs in englischer Sprache.